A 50 anni dall'uscita di Jaws: Come le narrazioni plasmano le nostre paure, e ci governano

Il film Lo Squalo non ha solo terrorizzato generazioni: ha mostrato come una narrazione ben costruita possa trasformare la percezione del reale. Oggi, tra fake news e intelligenza artificiale, quel potere è moltiplicato. Solo la cultura, come endoscheletro e esoscheletro insieme, può proteggerci da una nuova “Guerra dei Mondi” combattuta nella mente.

Il morso della narrazione: quando la comunicazione dirige i nostri passi – e le nostre paure

Riflessioni a cinquant’anni da Jaws

«Ci sono persone che non vollero più bagnarsi neppure in pochi centimetri d’acqua l’estate in cui Jaws uscì al cinema» – David Shiffman, biologo della conservazione, in Happy Birthday Jaws! How the movie changed shark science, Nature, 20 giugno 2025.

L’onda lunga di un ruggito meccanico

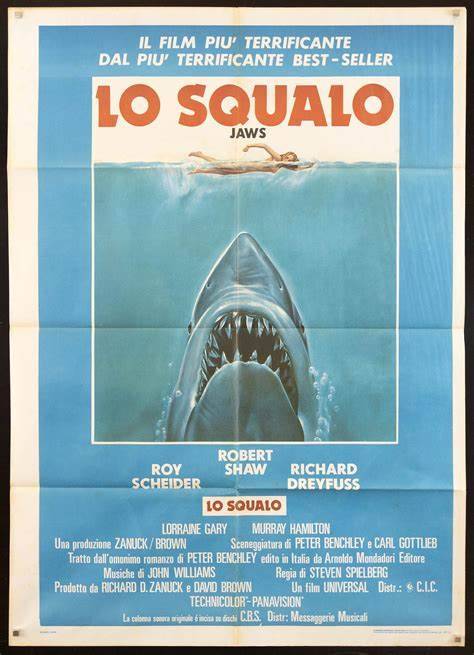

Cinquanta anni fa, il metallo e la gomma di un enorme modellino diedero voce a un istinto antichissimo: la paura del predatore. Steven Spielberg lo orchestrò con genio sinfonico, e la colonna sonora di John Williams segnò il nostro battito cardiaco.

Da allora, la pellicola non ha mai smesso di nuotare sotto la superficie dell’immaginario collettivo.

Anch’io – confesso – fui punto da quel dente d’acciaio: bambino, abbandonai la gioia del largo per un timore che, col tempo, si trasformò in vera e propria fobia. Da quell’estate, il mio rapporto con il mare cambiò, e con esso il mio sguardo sulla creatura che ne è simbolo. Il Jaws effect, termine coniato in letteratura di policy, è riuscito a modellare non solo le emozioni dei singoli, ma le scelte dei decisori pubblici.

Comunicazione spettacolare e comportamento: anatomia di un contagio emotivo

La sociologia della comunicazione insegna che le narrazioni ad alto impatto sensoriale – cinema, serie, videogiochi – attivano l’euristica della disponibilità: valutiamo il rischio di un evento in base alla vividezza con cui lo ricordiamo. Jaws, con la sua regia quasi documentaristica, rende “probabile” l’improbabile: oggi, in media, un essere umano ha più probabilità di essere morso da un altro passeggero nella metropolitana di New York che da uno squalo in qualunque oceano, ricorda Shiffman nell’intervista a Nature. Eppure, l’immagine del grande bianco in agguato appare a molti più persuasiva di qualunque statistica.

Questa discrepanza tra rischio percepito e rischio reale ha conseguenze tangibili:

- Comportamenti individuali – Riduzione delle attività balneari, acquisto di dispositivi “anti-squalo”, diffusione di racconti sensazionalistici sui social.

- Policy e gestione delle risorse – Pressioni pubbliche per campagne di abbattimento, reti anti-squalo, o turismo “adrenalinico” con pasturazione, spesso a danno degli ecosistemi.

- Immagine della specie – Semplificazione moralistica (lo squalo come “cattivo”), che oscura il suo ruolo chiave da predatore apicale e la minaccia reale: la pesca non sostenibile.

Dai titoli di testa alle leggi dello Stato

La forza di una narrazione non risiede solo nella sala buia: finisce nei talk-show, nei tweet, nelle copertine dei giornali.

L’etologo Frans de Waal parlava di “emozioni contagiose”; il marketing politico le traduce in consenso elettorale. Così, se una pellicola drammatizza un pericolo, l’elettore chiederà leggi che rispecchino tale urgenza. Nel caso degli squali, le normative anti-predatore nacquero in un periodo in cui la ricerca scientifica sui loro comportamenti era ancora embrionale. Ironia della sorte: proprio Spielberg, anni dopo, dichiarò di “doversi scusare” con questi animali.

Oggi la stessa comunicazione può cambiare rotta: la fotografia subacquea in altissima definizione, i documentari IMAX, le campagne di citizen science mostrano la meraviglia dell’etologia degli squali e il dramma della loro vulnerabilità.

L’arma narrativa, dunque, non è in sé buona o cattiva: è neutra come una lente; dipende da quali storie scegliamo di mettere a fuoco. Ma è estremamente potente.

Da Hollywood a Silicon Valley: le nuove Atene dell’immaginario planetario

«Ogni secolo elegge il suo crocevia: non più il luogo in cui si fabbricano stoffe o cannoni, ma quello in cui si forgiano le storie che governano i desideri»

— Jacques Attali, Breve storia del futuro, Fazi Editore, 2007, pp. 121-133.

Se, come abbiam visto, lo squalo meccanico di Spielberg mutò per sempre la nostra percezione dei predatori marini, Attali ci ricorda che la forza di quell’onda emotiva non risiede solo nella tecnica cinematografica, bensì nella posizione geografica – e culturale – di chi ne detiene i megafoni.

Los Angeles: capitale dell’iper-narrazione

Nella sua teoria delle città-cuore, Attali individua in Los Angeles la nona metropoli egemone: non l’arsenale di un impero militare, ma il laboratorio dove Hollywood intreccia immagini, suoni e miti che diventano lingua franca globale.

Jaws ne è emblema: girato in Massachussetts, ma concepito e post-prodotto sulla costa californiana, dimostra come il potere economico di una città coincida oggi con la sua capacità di sceneggiare la realtà. A Los Angeles, la fabbrica dei sogni si salda con piattaforme di streaming e influencer economy, amplificando il “Jaws effect” a velocità prima inconcepibili.

San Francisco: capitale dell’iper-rete

Attali, con intuizione profetica, accosta a Los Angeles San Francisco e l’intera Silicon Valley, culla di Google, Meta, X e di quell’ecosistema in cui il dato diventa la nuova spezia delle rotte commerciali. Se Hollywood produce la narrazione, la Bay Area ne distribuisce i pacchetti in tempo reale: algoritmi di raccomandazione, motori di ricerca, short-video che condensano paure e desideri in loop virali.

Nel contesto dello squalo, basta un frammento di film o una mini-clip su TikTok per riaccendere la fobia, mentre un documentario scientifico può disinnescarla. Qui la comunicazione non è più un fiume lineare, ma una miriade di torrenti personalizzati, capaci di orientare scelte di consumo (reti anti-squalo vendute online) o di impegno civico (petizioni digitali per le riserve marine).

Attali vede Los Angeles e San Francisco come poli gemelli: la prima scrive le sceneggiature emotive, la seconda ne codifica il tessuto neuronale in bit. Insieme modellano l’“iper-impero” – fase in cui il dominio non è imposto da eserciti, ma da immaginari condivisi e da reti di comunicazione che toccano il nostro polso biologico (dopamina, cortisolo) a ogni notifica.

Ecco perché la gestione della comunicazione diventa gestione dell’ecosistema: lì dove nascono i film e nascono le app, nascono di fatto le leggi non scritte dei nostri comportamenti collettivi.

Dal morso narrativo di Jaws giungiamo alle capitali contemporanee dell’influenza, dove la comunicazione non solo racconta il mondo, ma lo plasma. Comprenderne le dinamiche è il primo passo per trasformare la nostra paura in custodia – un compito che, dalla costa della California, può riverberare fino alle spiagge del Mediterraneo e oltre.

Dalla Guerra dei Mondi alla guerra dei bit: come il falso corre, si moltiplica, diventa realtà

«La menzogna viaggia a cavallo; la verità zoppica dietro, faticosa».

— Proverbio inglese, attualizzato dagli algoritmi

Velocità di propagazione: quando il falso batte il vero al fotofinish

Nel 2018 un team del MIT analizzò 126 000 “cascate” di notizie su Twitter: risultato, le false notizie raggiungono più persone, in meno tempo e con maggior profondità di retweet rispetto a quelle vere — fino a dieci volte più lontano e più veloce. La causa? L’attrattiva della novità e dell’emozione negativa, che stimola la condivisione umana più dei bot.

Un’analisi complementare pubblicata su Science lo stesso anno ha definito l’ecosistema della “scienza delle fake news”, evidenziando l’erosione delle barriere editoriali e l’urgenza di creare nuovi argini tecnici, normativi ed educativi.

Nel 1938 Orson Welles dimostrò che bastava un radiodramma verosimile per scatenare allarme nazionale. La sociologia successiva ha ridimensionato quella “psicosi”, ma ha confermato la vulnerabilità percettiva quando una finzione si traveste da notizia. (jstor.org)

Oggi, però, la minaccia è più subdola:

- Micro-targeting – ogni utente riceve una “realtà su misura”, grazie a profili psicografici e recommendation engine.

- Persistenza – i contenuti non svaniscono con lo spegnersi di una radio: algoritmi li ripropongono finché generano engagement, creando camere d’eco.

- Mimetismo multimodale – testo, video, audio sintetici convergono in feed indistinguibili, confondendo i sensi.

Così si può inscenare una War of the Worlds continua, a bassa intensità, che non scatena panico immediato ma corrode lentamente la fiducia epistemica, lasciando il pubblico incapace di distinguere tra realtà autentica e realtà “costruita”.

Se il sonoro del finto squalo di Spielberg e la voce metallica dei marziani di Welles furono lampi di terrore collettivo, l’ingegneria delle fake news contemporanee è una marea silenziosa. Viaggia più veloce della verità, costruisce realtà alternative e può orientare le nostre scelte politiche, sanitarie, ambientali.

Comprendere le dinamiche evidenziate dalla ricerca – la corsa del falso, l’ecologia dei bot, il potere grafico delle AI – è il primo passo per evitare che la “nuova Guerra dei Mondi” si combatta dentro di noi, nel fragile territorio della percezione.

L’apprendista stregone algoritmico: come l’IA alimenta la tempesta della disinformazione

«Non c’è più bisogno di alieni alla radio: bastano reti neurali ben addestrate per riscrivere, in tempo reale, la mappa di ciò che crediamo possibile.»

I grandi modelli linguistici (LLM) permettono di produrre miliardi di frasi al giorno, in ogni lingua, modulando tono, ideologia e lessico sul profilo psicografico del destinatario.

Il Center for Security and Emerging Technology (CSET) ha mostrato come questi modelli possano inserirsi in ogni fase di una operazione di influenza – dalla stesura all’amplificazione, fino all’adattamento istantaneo alle reazioni del pubblico, rendendo l’intervento umano quasi superfluo.

Un esperimento condotto dallo Stanford Internet Observatory ha misurato l’efficacia di articoli politici realizzati da AI rispetto a testi propagandistici tradizionali: i contenuti sintetici risultano più persuasivi e difficili da riconoscere come artefatti, soprattutto tra i lettori a bassa alfabetizzazione mediatica

Le reti generative che producono deepfake video-sonori hanno superato la soglia dell’“uncanny valley”: una rassegna sistematica 2024 enumera oltre cento architetture capaci di imitazioni fedelissime, mentre policy brief internazionali le definiscono “minaccia emergente alla sicurezza globale”.

Corsa agli armamenti: creare > rilevare

Per ogni modello che individua falsi, ne nasce uno che li occlude. Studi recenti sull’uso degli stessi LLM per detecting misinformation mostrano progressi, ma anche limiti strutturali: l’accuratezza cala su testi creati ad hoc e privi di segnali linguistici canonici.

La soglia tecnologica a vantaggio degli “attaccanti” resta dunque più bassa di quella richiesta ai “difensori”.

Paradossalmente, i modelli più avanzati “allucinano” di più: generano risposte convincenti che mescolano verità e invenzione. Secondo un’analisi pubblicata nel 2025, tali allucinazioni, se non corrette da meccanismi di fact-checking esterno, divengono semi perfetti per nuove fake news.

La celebre ricerca del MIT sui tweet del 2018 già dimostrava che il falso corre più veloce del vero; oggi l’IA ne fornisce un motore a reazione: contenuti personalizzati, replicabili all’infinito, capaci di bypassare filtri culturali e linguistici. Il risultato non è più un’ondata di panico improvviso, ma una scansione quotidiana della realtà in chiave distorta, che erode fiducia istituzionale, scienza, coesione sociale.

Linee d’allerta per l’era algoritmica

| Minaccia | Meccanismo IA | Possibile contromisura |

|---|---|---|

| Propaganda su misura | LLM che profilano e riscrivono il messaggio in tempo reale | Watermarking dei testi sintetici; tracciamento trasparente delle campagne |

| Deepfake hiper-realistici | GAN & diffusion models video-audio | Standard globali di firma digitale; educazione visiva avanzata |

| Hallucination & “fake-facts” | Allucinazioni presentate con tono assertivo | Retrieval-augmented generation e verifiche incrociate automatiche |

| Armi semantiche low-cost | Open-source fine-tuning su dataset di odio o complotti | Audit obbligatori sui modelli rilasciati al pubblico |

L’intelligenza artificiale, da strumento di meraviglia, rischia di diventare amplificatore di ombre: un apprendista stregone che moltiplica le voci di Orson Welles in milioni di podcast, reel e chatbot. Per evitare che la nuova Guerra dei Mondi si combatta dentro ogni timeline, occorre un’alleanza tra ricerca, regolazione e alfabetizzazione critica.

Solo così trasformeremo il codice che genera realtà alternative in codice di sicurezza collettiva, restituendo alla verità la dignità — e la velocità — necessarie a navigare il futuro.

Conclusione – Jaws ci insegna che è la cultura che ci salva

Il meccanico mostro marino di Jaws non ha solo addentato la nostra fantasia: ci ha rivelato quanto sia fragile l’argine della ragione quando un racconto è costruito con sapienza emotiva. In quella paura collettiva si nasconde una lezione duplice.

Un film – o un meme, o un deep-fake – può orientare più vite di un’intera biblioteca di dati statistici. Le immagini affondano dove i numeri scivolano: nel midollo delle emozioni. Il grande bianco è, per probabilità di attacco, meno pericoloso di un alveare o di un’automobile. Eppure il cinema lo ha eletto a minaccia archetipica. La mente umana valuta il pericolo con la vividezza del ricordo, non con la logica della frequenza.

Dal 1975 a oggi, Jaws vive di citazioni, remix, gif. Ogni riapparizione rinsalda il riflesso pavloviano della paura, dimostrando che la “mezza vita” di una suggestione è più lunga di quella di molti fatti.

QUali sono allora le precauzioni per l’era delle narrazioni totali.

Proviamo a riassumerlo in questa tabella:

| Rischio | Antidoto operativo |

|---|---|

| Paura amplificata da immagini sensazionalistiche | Confrontare sempre un dato emotivo con un dato empirico (statistiche ufficiali, fonti scientifiche). |

| Disinformazione virale | Applicare il “metodo delle tre domande”: Chi parla? Che prove porta? Chi ha da guadagnarci? |

| Eco-chambers algoritmiche | Programmarsi “diete mediatiche” variate: testate di paesi diversi, linguaggi diversi, formati lenti accanto a quelli rapidi. |

| Allucinazioni dell’IA | Pretendere trasparenza sui contenuti generati (watermark, dichiarazioni d’origine) e incentivare sistemi di verifica incrociata. |

Cultura: è l’unico «sistema binario» di protezione

Le leggi, i regolamenti, i codici informatici sono eso-scheletri: strutture rigide che provano a contenerci dall’esterno. Ma la disinformazione corre più in fretta delle gazzette ufficiali e delle patch di sicurezza.

La cultura è invece endo- e eso-scheletro insieme:

- Endoscheletro – forma la nostra ossatura interna: senso critico, curiosità, capacità di stupirci senza cedere all’inganno.

- Esoscheletro – si manifesta in istituzioni educative, biblioteche digitali, festival scientifici, reti di fact-checker che proteggono la collettività.

Solo questo doppio strato vivente cresce con noi, si adatta, risponde con elasticità alle nuove metamorfosi delle menzogne. È l’unico scudo che non arrugginisce quando l’avversario cambia arma.

Un impegno che inizia dal singolo

- Sostenere progetti culturali: dal documentario sulla biologia marina alla start-up che sviluppa giochi educativi, ogni iniziativa alimenta il nostro “calcio” cognitivo.

- Finanziare giornalismo lento: abbonarsi a testate che verificano, approfondiscono, contestualizzano è un atto di manutenzione del bene pubblico.

- Coltivare meraviglia informata: tornare a esplorare il mare con rispetto, magari assistiti da guide scientifiche, per trasformare la paura in stupore protettivo.

Epilogo

Quando la pinna artificiale di Spielberg solcò lo schermo, ci costrinse a fissare l’abisso – ma anche a chiederci quanto fosse reale. Oggi, in un oceano di bit, altre pinne digitali possono emergere in ogni timeline. Se vogliamo nuotare senza farci divorare dalle ombre, dobbiamo alimentare la cultura come scheletro fluido che ci regge dentro e ci difende fuori.

Tutto il resto – norme, algoritmi, filtri – è utile, ma non sufficiente: come reti da pesca, proteggono un tratto di acqua; la cultura, invece, trasforma l’intero mare in uno spazio abitabile. E ci ricorda, ogni volta che la musica incalza, di chiedere: è davvero uno squalo, o solo la nostra immaginazione in technicolor?

📚 Fonti principali (articolo di partenza)

-

Nature, “Happy birthday Jaws! How the movie changed shark science”, 20 giugno 2025

↳ Intervista a David Shiffman, biologo marino autore di Why Sharks Matter (2022)

🧠 Ricerche scientifiche su disinformazione e diffusione delle fake news

-

Vosoughi, S., Roy, D., & Aral, S. (2018) — The spread of true and false news online, Science, 359(6380), 1146–1151

↳ Studio condotto su 126.000 notizie su Twitter: le notizie false si diffondono significativamente più velocemente delle vere.

https://www.science.org/doi/10.1126/science.aap9559 -

Lazer, D. et al. (2018) — The science of fake news, Science, 359(6380), 1094–1096

↳ Invito alla costruzione di nuove barriere cognitive, educative e tecnologiche contro la disinformazione.

https://www.science.org/doi/10.1126/science.aao2998 -

Shao, C. et al. (2018) — The spread of low-credibility content by social bots, Nature Communications, 9, 4787

↳ Ruolo dei social bot nella diffusione di contenuti falsi durante eventi politici e crisi.

https://www.nature.com/articles/s41467-018-06930-7

🤖 Intelligenza artificiale e disinformazione

-

Center for Security and Emerging Technology (CSET) (2023) — Generative Language Models and Influence Operations

↳ Analisi dei possibili usi (e abusi) dell’IA generativa per scopi di propaganda. -

Stanford Internet Observatory (2023) — LLMs in Political Persuasion

↳ Studio sperimentale: l’IA genera contenuti politici spesso più persuasivi degli umani. -

Floridi, L. & Chiriatti, M. (2020) — GPT-3: Its Nature, Scope, Limits, and Consequences, Philosophy & Technology, 34

↳ Analisi filosofica e tecnica dell’uso dei modelli linguistici nella generazione di “verità verosimili”. -

Brundage, M. et al. (2018) — The Malicious Use of Artificial Intelligence: Forecasting, Prevention, and Mitigation

↳ Documento che analizza i rischi strategici associati a deepfake, LLM e agenti sintetici.

🎭 Riferimenti storici e culturali

-

Attali, J. (2007) — Breve storia del futuro, Fazi Editore

↳ Capitolo sulle “città-cuore”: Los Angeles e San Francisco come capitali dell’immaginario contemporaneo. -

Cantril, H. (1940) — The Invasion from Mars: A Study in the Psychology of Panic, Princeton University Press

↳ Studio sociologico sulla trasmissione radiofonica della Guerra dei Mondi di Orson Welles (1938) e sull’effetto panico.

📊 Strumenti e strategie per contrastare la disinformazione

-

Roozenbeek, J. & van der Linden, S. (2019) — The fake news game: actively inoculating against the risk of misinformation, Journal of Risk Research, 22(5)

↳ Teoria dell’inoculazione applicata alle fake news: piccoli “vaccini” cognitivi per rafforzare il pensiero critico. -

Europol (2023) — Facing Reality? Law Enforcement and the Challenge of Deepfakes

↳ Rapporto sulle implicazioni legali e tecnologiche dei contenuti sintetici nell’informazione pubblica.

AI - Intelligenza Artificiale

Tutto sull’intelligenza artificiale nel settore AEC: progettazione, BIM, cantiere, manutenzione e gestione tecnica. Scopri come l’AI sta cambiando il lavoro dei professionisti delle costruzioni.

Ambiente

Ambiente e costruzioni: soluzioni, norme e tecnologie per una progettazione sostenibile. Approfondimenti e casi studio per tecnici e progettisti che vogliono ridurre l’impatto ambientale del costruire.

Condividi su: Facebook LinkedIn Twitter WhatsApp